Vol. 11, n. 2, ottobre 2025

TEORIE E MODELLI DIDATTICI

L’Intelligenza Artificiale a scuola1

Maria-Chiara Michelini2 e Sophia Crescentini3

Sommario

Il contributo affronta la questione dell’irruzione dell’Intelligenza Artificiale (IA) nella vita quotidiana del nostro tempo, la quale comporta importanti trasformazioni in ordine a consuetudini, operatività ordinaria e professionale, strumenti e prospettive. Anche la scuola è investita da questa rivoluzione, ed è chiamata ad accogliere le sfide da essa poste, al fine di dirigerne i processi alla luce del proprio orizzonte teleologico, massimizzandone le opportunità e gestendone i potenziali rischi. In questa direzione, si ritiene utile comprendere l’orientamento e le azioni assunti in ambito scolastico nei confronti dell’IA. A tal fine, l’articolo illustra i primi risultati di un’indagine volta a sondare le opinioni e le pratiche dei docenti relativamente all’impiego dell’IA in ambito educativo e didattico.

Parole chiave

Intelligenza artificiale, Scuola, Educazione, Indagine, Insegnanti.

DIDACTIC THEORIES AND MODELS

Artificial Intelligence in schools

Maria-Chiara Michelini4 and Sophia Crescentini5

Abstract

The contribution addresses the issue of the irruption of Artificial Intelligence in our everyday lives, which entails major transformations in customs, ordinary and professional operations, tools, and perspectives. Schools too are affected by this revolution and are called upon to embrace the challenges it poses, in order to direct its processes in the light of its own teleological horizon, maximising the opportunities and managing the potential risks. In this direction, it is considered useful to understand the orientation and actions taken in schools concerning AI. For this purpose, the paper presents the first results of a survey conducted and aimed at probing teachers’ opinions and practices regarding the use of AI in education and teaching.

Keywords

Artificial intelligence, School, Education, Survey, Teachers.

Progetto Umano e IA

L’Intelligenza Artificiale (IA) si sta imponendo a ritmo crescente nella vita quotidiana del nostro tempo, modificando in misura significativa consuetudini, operatività ordinaria e professionale, prospettive e strumenti disponibili a tutti i livelli. Questa trasformazione assume il carattere di una vera rivoluzione che sta sfidando in senso globale e capillare concezioni, sistemi, soggetti e istituzioni. Attorno e a partire dall’IA si sta muovendo una riflessione culturale estremamente ampia, sia pure di diverso segno, a fronte non solo della consapevolezza dell’ineluttabilità del processo rivoluzionario avviato, ma anche della potenza e della portata del medesimo.

In tal senso, da più parti vengono intercettati e tematizzati rischi e potenzialità di quello che non può essere considerato un semplice mezzo tra i tanti disponibili, ma un vero e proprio sistema che può mostrare capacità umane quali il ragionamento, l’apprendimento, la pianificazione e la creatività, permettendo alle macchine che ne sono dotate di capire l’ambiente in cui sono inserite, percepire e risolvere problemi, processando i dati disponibili e adattando l’azione in maniera autonoma, sulla base degli effetti rilevati. Ad esempio, nel Regolamento Europeo sull’Intelligenza Artificiale (2024), l’IA viene definita come «un sistema automatizzato progettato per funzionare con diversi livelli di autonomia e che può mostrare capacità di adattamento dopo l’installazione e che, per obiettivi espliciti o impliciti, deduce, dagli input che riceve, come generare output quali previsioni, contenuti, raccomandazioni o decisioni che possono influenzare ambienti fisici o virtuali».

La natura dell’IA non consente di ignorare alcuni rischi per l’uomo, quali: svalutazione delle capacità, rimozione delle responsabilità, riduzione del controllo e conseguente erosione della determinazione umana. Molte professioni possono già essere svolte efficacemente e con grande risparmio di tempo e risorse da sistemi di IA e molte subiranno trasformazioni importanti in futuro, alcune probabilmente spariranno, mentre ne sorgeranno di nuove che, al momento, fatichiamo a immaginare.

Tutto ciò comporta inevitabili timori, alcuni del tutto legittimi, quali quelli relativi alla perdita di una quota significativa di posti di lavoro, altri considerati irrazionali da studiosi del settore e analisti avveduti, che spiegano in maniera precisa e circostanziata, ad esempio, perché sia impossibile il superamento dell’intelligenza umana da parte di quella artificiale. Al tempo stesso vengono avanzate proposte estreme di transumanesimo, come il superamento definitivo dell’umano, cui corrisponde il mind uploading, vale a dire il vero e proprio trasferimento della mente dal cervello alla macchina (Moravec, 1988). Studiosi acclarati, come Harari (2018), denunciano la possibilità oggi realistica di hackerare l’uomo, da parte di chi governa e domina dati, potenza di calcolo e conoscenza biologica, la cui combinazione corrisponde al potere di manipolazione estrema.

Da più parti si ritiene che la portata e lo straordinario potenziale dell’IA rendano urgente una riflessione di tipo etico, non soltanto per gli usi estremi, come quello delle cosiddette armi autonome nei conflitti mondiali, le quali stanno producendo una disumanizzazione senza pari (in quanto condotte senza costi umani per l’attaccante), con l’uccisione di persone da parte di macchine dotate di IA. Ciò che è in gioco è il progetto umano per l’era digitale (Floridi, 2022): quale uomo auspichiamo abiti il mondo in futuro, con l’aiuto dell’IA? Vogliamo che oggi e in futuro l’uomo faccia da sensore o, viceversa, che sia la macchina a controllare l’uomo? (Benanti, 2022). Benanti, membro del consiglio ONU sull’Intelligenza Artificiale e del Comitato di Coordinamento italiano per l’aggiornamento delle strategie sull’utilizzo dell’AI, utilizza il neologismo di Algoretica, ponendosi nella prospettiva di un eticista della tecnologia, che si interroga sull’uso di macchine che lavorano dati all’interno di uno spazio sociale condiviso, che è e possa continuare a essere democratico, secondo finalità e modalità coerenti.

Il menzionato Regolamento Europeo sull’IA del 2024 che, facendo da apripista mondiale, si interroga sui potenziali rischi e sui possibili danni sociali, giunge, ad esempio, a formulare il divieto di manipolazione comportamentale cognitiva e il riconoscimento delle emozioni sul luogo di lavoro o a scuola. L’UNESCO nel 2021 ha prodotto una Raccomandazione sull’etica dell’IA, seguita, nel 2023, da una Guida per l’intelligenza artificiale generativa nell’istruzione e nella ricerca. L’IA va affrontata con un approccio umanistico, ancor prima che scientifico e tecnologico.

Anche la scuola è investita da questa rivoluzione con tutto il portato di timori e interesse positivo a fronte delle potenzialità e dei rischi percepiti. Dal nostro punto di vista riteniamo che, alla luce di questa importante trasformazione sociale, la riflessione pedagogica sia chiamata a ridefinire il senso stesso dell’educare e, in esso, dell’insegnare e dell’apprendere. Entrando ancora più nello specifico, riteniamo che il tema del rapporto tra il pensiero, e la sua formazione, e IA sia uno di quelli su cui la scuola è maggiormente interpellata.

L’economia di questo contributo non consente l’approfondimento di questioni che meritano ben altro respiro. Ci limiteremo a sintetiche considerazioni volte a evidenziare grossolanamente alcuni snodi essenziali. L’IA ci pone di fronte a un’alternativa radicale tra la possibilità di abdicazione di molte capacità tipicamente umane, attraverso un progressivo allineamento al design del mondo a misura di IA, fino allo snaturamento stesso dell’uomo e, da parte opposta, a un incremento diffuso di capacità di pensiero riflessivo di livello superiore, atte a finalizzare da un punto di vista educativo l’IA allo sviluppo umano.

Floridi avverte circa il rischio di avvolgimento del mondo a misura di IA: «Il successo dell’IA è in gran parte dovuto al fatto che stiamo costruendo un ambiente adatto ad essa, in cui le tecnologie intelligenti si trovano a casa mentre noi siamo più simili a sommozzatori. È il mondo che si sta adattando all’IA e non viceversa» (Floridi, 2022, p. 54). L’infosfera, l’ambiente informazionale in cui siamo costantemente connessi, insieme ad altri agenti naturali e artificiali, che processano informazioni in modo logico e autonomo, sta sempre più divenendo il mondo in cui viviamo (Floridi, 2017). E questo spazio viene pensato e costruito a misura degli artefatti tecnologici che lo abitano.

La domanda di fondo può essere formulata sinteticamente in questo modo: dobbiamo formare persone capaci di conformarsi alle esigenze dell’IA e dell’infosfera, attrezzandole di competenze e capacità utili al loro uso efficace ed esperto, o dobbiamo educare persone autonome, dotate di capacità critiche, riflessive, immaginative e creative necessarie, certo, a utilizzare al meglio l’IA, ma soprattutto a definire le finalità delle tecnologie, anche disegnandole e governandole in vista del progetto umano elaborato e condiviso? L’educazione e, segnatamente, l’istruzione sono dunque da ripensare come processi di addestramento o, al contrario, come processi ancora più forti e incisivi per abitare democraticamente un mondo altamente tecnologico e connesso?

Evidentemente la risposta di chi scrive appare marcatamente orientata nella direzione del progetto umano che prevede un’educazione volta alla crescita di tutta la popolazione mondiale, per uno sviluppo autentico, pieno e democratico dell’intera comunità umana. Ciò comporta un profilo docente consapevole di tali sfide, un docente metariflessivo, conscio dell’ineludibile complessità delle sfide in gioco e perciò intenzionalmente proteso verso il futuro, con una visione di lungo periodo, capace di sviluppare in senso riflessivo la consapevolezza critica (storica ed epistemologica) della problematica formativa. Di qui il docente dovrà essere in grado di compiere scelte strategiche forti, atte a creare condizioni e contesti idonei alla formazione, in sinergia con le sfere politiche e istituzionali.

Tale profilo richiede, come primo passo, un elevato grado di consapevolezza e di coinvolgimento. In tal senso, riteniamo necessario cercare di comprendere la percezione degli insegnanti in ordine all’IA. Il docente metariflessivo è anzitutto intellettualmente impegnato nell’esercizio della miglior forma di pensiero possibile in senso attivo e protagonista, nello specifico in ordine all’IA. In tal senso sono già disponibili studi quale quello della regione Veneto che ha indagato la percezione dei docenti relativamente all’introduzione dell’IA generativa nel contesto scolastico (Petrucco, Favino e Conte, 2024).

L’IA a scuola: un’indagine esplorativa

In questa direzione, il presente contributo riferisce di un’indagine esplorativa da noi condotta, volta a sondare le opinioni e le pratiche dei docenti relativamente all’impiego dell’IA in ambito educativo e didattico, esplorando due dimensioni.

La prima investe il profilo professionale personale circa la considerazione dell’IA come strumento di supporto, amplificazione e sviluppo delle proprie facoltà cognitive di ordine superiore, quali pensiero riflessivo e critico, pensiero divergente e creatività in ambito lavorativo, oltre che nelle prassi didattiche, come tecnologia da utilizzare con gli allievi sia come medium didattico che come oggetto di alfabetizzazione e educazione.

La seconda direzione di ricerca riguarda invece la percezione che i docenti hanno rispetto all’uso dell’IA da parte dei loro allievi. A tal fine, è stato somministrato un questionario, redatto e condiviso tramite Google Moduli, a docenti di scuola primaria e secondaria di primo e di secondo grado, nell’arco temporale tra il 9 e il 26 aprile 2025. Ci si è avvalsi di un campione di convenienza: il questionario è stato inviato a tutte le scuole statali degli ordini interessati della regione Marche ed è stato diffuso, attraverso passaparola, anche in altre regioni italiane, invitando i docenti a aderire su base volontaria. Sono stati raggiunti 321 insegnanti, le cui risposte sono state raccolte in forma anonima. Il questionario si compone di 26 domande, riportate nella figura 1, alcune a risposta chiusa (scala Likert 1-5, risposta sì/no, scelta multipla); altre di tipo aperto. I risultati sono stati analizzati con il supporto del software per analisi miste MAXQDA. In particolare, le risposte alle domande chiuse sono state esaminate in maniera quantitativa, mentre le repliche ai quesiti aperti sono state sottoposte a un’analisi tematica secondo un approccio bottom-up: è stata effettuata una ripetuta lettura dei dati allo scopo di individuare, per ciascun quesito, le tematiche ricorrenti, le quali sono state aggregate per somiglianza semantica, al fine di definire corrispondenti categorie di analisi; in ultimo, è stata calcolata la frequenza di ogni categoria.

Figura 1

|

Questionario |

|

ANAGRAFICA |

|

Q1. Da quanti anni insegna? |

|

Q2. Con quale tipologia contrattuale è stato assunto? |

|

Q3. In quale ordine di scuola insegna? |

|

Q4. Se insegna in una scuola secondaria di secondo grado, specifichi la tipologia. |

|

Q5. Quali discipline insegna? |

|

IA E PROFESSIONALITÀ DOCENTE |

|

Q6. In una scala da 1 a 5, dove collocherebbe attualmente l’effetto dell’IA nell’esercizio della sua professione? |

|

Q7. Quali opportunità individua principalmente? |

|

Q8. Quali rischi individua principalmente? |

|

Q9. Impiega l’IA nell’esercizio della sua professione (non solo nell’attività didattica strettamente intesa, ma anche, ad esempio, per questioni organizzative, di pianificazione, ecc.)? |

|

Q10. Se ha risposto sì al quesito 9, in che modo, con quali strumenti e finalità impiega l’IA? |

|

Q11. In una scala da 1 (minimo) a 5 (massimo), quanto si ritiene preparato in merito alle seguenti dimensioni di competenza relative all’AI in qualità di docente? |

|

Q12. L’utilizzo di tecnologie di IA in ambito professionale costituisce uno strumento di supporto, amplificazione e sviluppo delle proprie facoltà cognitive di ordine superiore, quali pensiero riflessivo e critico, pensiero divergente e creatività. In una scala da 1 (fortemente in disaccordo) a 5 (fortemente d’accordo), quanto condivide questa affermazione? |

|

IA E EDUCAZIONE DEGLI ALLIEVI |

|

Q13. In una scala da 1 (minimo) a 5 (massimo) quanto ritiene che i suoi allievi impieghino l’IA nel processo di apprendimento? |

|

Q14. Che uso ne fanno principalmente? (Qualora non la impiegassero, specificare «nessun utilizzo»). |

|

Q15. In una scala da 1 (estremamente negativo) a 5 (estremamente positivo), dove collocherebbe attualmente l’effetto dell’IA sull’apprendimento dei suoi allievi? |

|

Q16. Quali opportunità individua principalmente? |

|

Q17. Quali rischi individua principalmente? |

|

Q18. Impiega l’IA come strumento di mediazione didattica? |

|

Q19. In una scala da 1 (minimo) a 5 (massimo), quanto ritiene utile impiegare l’IA come strumento di mediazione didattica? |

|

Q20. Se ha risposto sì al quesito 18, riporti almeno un esempio di strumento utilizzato e delle relative modalità di impiego. |

|

Q21. L’alfabetizzazione e l’educazione all’IA costituiscono un aspetto dell’offerta formativa del suo istituto e/o una finalità della sua programmazione didattica? |

|

Q22. Promuove l’alfabetizzazione e l’educazione all’IA all’interno della sua attività didattica? |

|

Q23. In una scala da 1 (minimo) a 5 (massimo), quanto ritiene utile alfabetizzare e educare gli allievi rispetto all’IA? |

|

Q24. Se ha risposto sì al quesito 22, risponda alla seguente domanda. In una scala da 1 (minimo) a 5 (massimo), quanto ritiene di perseguire l’obiettivo dell’alfabetizzazione e dell’educazione all’IA relativamente alle seguenti dimensioni di competenza? |

|

Q25. L’utilizzo di tecnologie di IA costituisce uno strumento di supporto, amplificazione e sviluppo delle facoltà cognitive di ordine superiore degli allievi, quali pensiero riflessivo e critico, pensiero divergente e creatività. In una scala da 1 (fortemente in disaccordo) a 5 (pienamente d’accordo), quanto condivide questa affermazione? |

|

PROSPETTIVE DI RICERCA E FORMAZIONE |

|

Q26. In una scala da 1 (minimo) a 5 (massimo), quanto riterrebbe utile un percorso di ricerca-azione volto a indagare e sviluppare prospettive formative e educative, per insegnanti e allievi, in relazione a un approccio umano all’IA, che la interpreti quale strumento di supporto, amplificazione e sviluppo delle facoltà cognitive di ordine superiore (ad esempio, pensiero riflessivo e critico, pensiero divergente e creatività)? |

Questionario

Analisi e discussione dei risultati

Il questionario è stato compilato da n. 321 docenti, di cui n. 92 (28,9%) in servizio presso la scuola primaria, n. 112 (34,9%) in servizio presso la secondaria di primo grado, n. 112 (34,9%) in servizio presso la secondaria di secondo grado, n. 3 (0,9%) in servizio presso la scuola secondaria sia di primo che di secondo grado, n. 1 (0,3%) in servizio sia presso la scuola primaria che presso la secondaria di secondo grado, n. 1 (0,3%) in servizio presso tutti e tre gli ordini di scuola considerati.

Dopo ulteriori quesiti di tipo anagrafico, è stata dedicata una sezione del questionario all’IA in relazione alla professionalità insegnante. In quest’ambito, è stato chiesto di stimare l’effetto dell’IA nell’esercizio della propria professione, con riferimento a una scala da 1 (estremamente negativo) a 5 (estremamente positivo); la media delle risposte (2,57) si attesta fra il secondo e il terzo livello della scala Likert, a indicare, dunque, come l’IA non venga considerata, attualmente, dalla maggior parte dei docenti intervistati, uno strumento con ricadute particolarmente positive sul proprio ambito lavorativo; soltanto il 6,5% (n. 21) dei rispondenti, infatti, ha indicato il livello massimo.

A questo proposito, è stato chiesto quali opportunità e quali rischi si individuassero relativamente all’impiego professionale dell’IA; le stesse domande sono state poste nella sezione «IA e educazione degli allievi» con riferimento all’utilizzo dell’IA da parte degli educandi. Le risposte ai quesiti delle due sezioni sono state analizzate in maniera congiunta in quanto, nel segmento dedicato all’uso dell’IA da parte dei docenti, la maggior parte di essi, in particolar modo per quanto concerne il quesito relativo ai potenziali rischi, ha fornito opinioni relative agli alunni e non a sé. Non solo, alcuni hanno replicato semplicemente rinviando a quanto espresso nella sezione relativa ai docenti.

Tale atteggiamento può essere dovuto a una non piena chiarezza della suddivisione e della modalità di porre i quesiti del questionario; tuttavia, considerando che il fraintendimento si è verificato soprattutto per quanto concerne l’individuazione dei rischi, è possibile che si celino ragioni più profonde. Nello specifico, ciò potrebbe essere interpretato come un comportamento indiziario della difficoltà di riflettere in merito alla propria pratica professionale; in particolar modo, quando ciò comporta il prendere coscienza dei propri schemi mentali e delle premesse su cui si reggono le proprie modalità di pensiero e azione, anche in una prospettiva di trasformazione degli stessi (Michelini, 2013, 2016). In questo caso, infatti, delineare i rischi potenzialmente derivanti dall’utilizzo personale dell’IA non significa ragionare puramente in merito alle caratteristiche dello strumento, ma anche in ordine ai personali modi di pensare e agire relativamente ad esso.

Per quanto concerne il contenuto delle risposte in oggetto, il 13,58% (n. 85) dichiara di considerare le opportunità offerte dall’IA nulle o fortemente limitate; segue un 13,45% di risposte (n. 84) nelle quali viene sottolineato come tale tecnologia rappresenti uno strumento valido nella ricerca di informazioni e approfondimenti; nell’11,50% delle risposte (n. 72) l’IA viene intesa quale supporto allo studio, mentre il 9,74% (n. 61) sottolinea la sua utilità nella produzione di materiali didattici, specie di tipo multimediale. Il 9,27% (n. 58) evidenzia la possibilità di velocizzare alcune attività, coerentemente con le dichiarazioni in merito all’utilità dell’IA nell’assolvere gli adempimenti burocratici (n. 46; 7,35%) o tradurre documenti (n. 2; 0,32%). Il 6,55% (n. 41) delle risposte riguarda l’impiego dell’IA nella pianificazione e nella progettazione didattica, anche in relazione a processi di individualizzazione e personalizzazione (n. 28; 4,47%) e all’adozione di una pluralità di strategie didattiche (n. 24; 3,83%); mentre un ulteriore 3,83% (n. 24) concerne il suo utilizzo nelle attività di verifica, valutazione e feedback. Essa viene interpretata come espediente per favorire l’inclusione (n. 16; 2,56%) e la motivazione degli allievi (n. 16; 2,56%). Inoltre, l’IA è stata considerata anche come uno strumento di supporto allo sviluppo di abilità, competenze e disposizioni di ragionamento (n. 28; 4,47%), creative (n. 11; 1,76%), informatiche (n. 3; 0,8%) ed etiche (n. 2; 0,32%).

N. 25 risposte (3,99%) sono state codificate come «Altro» in quanto espresse in maniera troppo generica per poter essere categorizzate senza incorrere in un eccesso interpretativo; ciò si è verificato anche per gli altri quesiti di tipo aperto. Il maggiore dei rischi individuati rinvia alla possibilità di una scarsa attivazione cognitiva, per lo più da parte degli allievi, e di sostituzione dell’umano da parte dell’IA (n. 144; 26,23%); coerentemente con tali affermazioni, il 5,28% (n. 29) delle risposte considera una generale riduzione delle conoscenze e competenze e altre esprimono il timore per una diminuzione delle capacità di ragionamento (15,48%; n. 85), creative (n. 40; 7,29%), attentive e mnestiche (n. 10; 1,82%), affettive e relazionali (n. 9; 1,64%) e manuali (n. 3; 0,55%). Il 12,02% (n. 66) fa riferimento a un generico impiego improprio e non consapevole dell’IA e il 7,29% (n. 40) a un suo eccessivo utilizzo con rischio di dipendenza da tecnologia.

Altre opinioni riflettono in merito ai rischi relativi alla natura e all’attendibilità dei contenuti generati e diffusi tramite l’IA, sottolineando, in particolare, la possibilità di un’eccessiva semplificazione e omologazione (n. 19; 3,46%), oltre a fenomeni riconducibili alla categoria del disordine informativo (n. 46; 8,38%). Il 2,13% (n. 13) considera questioni inerenti alla lesione della privacy e di principi etici; mentre il 4,01% (n. 22) dichiara di non essere in grado di individuare un rischio ben preciso o di non rilevarne alcuno. È stata considerata, in ultimo, una categoria «Altro» (n. 23; 4,19%) per le medesime ragioni esposte in precedenza. Emerge, dunque, come, in generale, nonostante l’introduzione dell’IA a scuola venga interpretata come potenziale valido supporto, tanto nelle attività del docente quanto in quelle degli allievi, si avverta il diffuso timore che tale tecnologia possa sostituirsi all’umano, determinandone una riduzione di virtuose capacità e disposizioni.

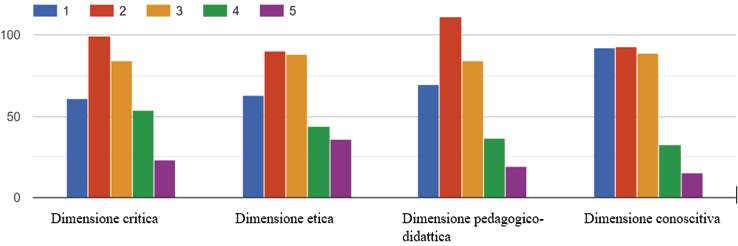

I docenti che hanno dichiarato di impiegare l’IA nell’esercizio della propria professione corrispondono al 37,1% (n. 119) degli intervistati; pertanto, la percentuale maggiore (n. 202; 62,1%) è rappresentata da coloro che non l’adoperano. Nella medesima sezione è stato poi indagato il grado di percezione delle proprie capacità di impiego dell’IA relativamente a quattro dimensioni di competenza: critica, etica, pedagogico-didattica e conoscitiva. Tali ambiti sono stati individuati anche in relazione a quanto proposto dall’UNESCO (2024a) nell’AI competency framework for teachers. Per ciascuna dimensione è stato chiesto di autovalutare il proprio grado di preparazione in una scala da 1 a 5. Per quanto concerne l’ambito critico, la media delle risposte corrisponde a 2,62, quella relativa alla dimensione etica a 3,32, quella riguardante i livelli indicati in relazione alle abilità pedagogico-didattiche assume un valore di 2,45, mentre la media dei valori riferiti alla dimensione conoscitiva è di 2,33. Fatta eccezione per gli aspetti relativi alla riflessione etica, in media, le conoscenze e le competenze autopercepite dei docenti relative all’IA sembrano raggiungere appena un livello medio. La distribuzione delle frequenze è descritta dalla figura 2.

Figura 2

Livelli di autopercezione di competenza rispetto all’impiego dell’IA.

L’ultimo quesito in merito all’IA relativamente alla professione insegnante chiedeva di esprimere, in una scala da 1 (fortemente in disaccordo) a 5 (pienamente d’accordo), il grado di accordo rispetto alla seguente affermazione: «l’utilizzo di tecnologie di IA in ambito professionale costituisce uno strumento di supporto, amplificazione e sviluppo delle proprie facoltà cognitive di ordine superiore, quali pensiero riflessivo e critico, pensiero divergente e creatività».

La media delle risposte assume un valore di 2,70; la percentuale maggiore dei rispondenti (n. 114; 35,5%) ha indicato il livello 3, solo il 7,2% (n. 23) ha indicato il grado massimo. La stessa domanda è stata posta anche in relazione allo sviluppo delle capacità di pensiero degli allievi e, in questo caso, la media delle risposte corrisponde a 2,40. Ciò appare coerente con quanto osservato rispetto all’analisi relativa alla percezione di opportunità e rischi derivanti dall’impiego dell’IA, da cui emerge come l’utilizzo di tale strumento relativamente all’esercizio delle capacità superiori di pensiero venga considerato tanto come potenziale elemento positivo quanto come possibile ostacolo.

La sezione successiva del questionario era finalizzata a rilevare le opinioni e le pratiche degli insegnanti in merito all’IA in relazione alla formazione degli allievi. I docenti hanno specificato che i propri alunni ne fanno per lo più un uso relativo allo svolgimento di consegne e compiti (n. 170; 48,02%); seguono la percentuale di risposte in cui si dichiara che gli allievi non la impiegano (n. 82; 23,16%) e quella relativa all’uso dell’IA per la ricerca di informazioni (n. 43; 12,15%). L’1,98% (n. 7) spiega come l’IA sia adoperata in attività ludiche, n. 2 risposte (0,56%) riguardano il suo impiego nell’ambito di esperienze di apprendimento cooperativo e n. 1 risposta (0,20%) nell’esecuzione di esperimenti. Il 6,21% (n. 22) è stato ricondotto alla categoria «Altro».

È stato, inoltre, chiesto di valutare, in una scala da 1 a 5, l’attuale effetto dell’IA nell’apprendimento dei propri allievi; la media delle risposte assume un valore di 2,19. Si evidenzia come gran parte di coloro che hanno menzionato l’utilizzo dell’IA nello svolgimento di consegne e compiti e nella ricerca di informazioni abbia sottolineato il fatto che, in tali attività, l’IA viene adoperata in maniera acritica, spesso sostituendo totalmente gli allievi nel processo di apprendimento. Ciò sembra avvenire, in particolar modo, nella produzione di testi e nell’effettuare traduzioni, cosa che potrebbe minare fortemente l’esercizio e l’acquisizione delle competenze linguistiche, oltre allo sviluppo delle capacità di pensiero già menzionate. Le media delle risposte in merito alla stima dell’effetto dell’IA sul processo di apprendimento degli allievi e la rilevazione di un preponderante uso inconsapevole richiamano l’attenzione sull’urgenza di considerare l’IA come oggetto di educazione. Infatti, se impedire l’impiego dell’IA da parte degli allievi costituisce una possibilità più che remota, dato il facile accesso a tale strumento, quando non inopportuna, la via per scongiurare il rischio che essa venga adoperata impropriamente potrebbe essere quella di educare al suo impiego così come quella di ridefinire alcune caratteristiche e modalità dei processi di insegnamento e apprendimento.

I quesiti successivi erano dedicati all’alfabetizzazione e all’educazione all’IA. Dapprima, si è investigata l’effettiva promozione dell’alfabetizzazione e dell’educazione all’IA attraverso l’attività didattica dei docenti intervistati: il 70,4% di essi (n. 226) ha risposto in maniera negativa, mentre il 29,6% (n. 95) affermativamente. A tal proposito, è stato chiesto quanto si ritenesse utile, in una scala da 1 a 5, alfabetizzare e educare gli allievi rispetto all’IA: la media delle risposte corrisponde a 3,45; il 28% dei rispondenti (n. 90) ha indicato il livello 5. Dunque benché, come emerge dalle repliche al quesito precedente, allo stato attuale, l’AI literacy non costituisca una diffusa e condivisa finalità pedagogico-didattica, se ne avverte comunque la necessità.

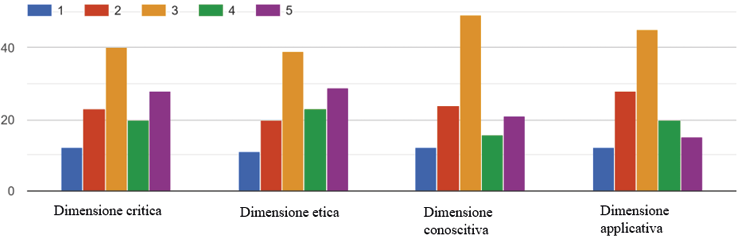

A coloro che hanno dichiarato di perseguire tale obiettivo, è stato chiesto di stimare la propria azione rispetto allo sviluppo delle seguenti dimensioni di competenza: dimensione critica (la media delle risposte ottenute corrisponde a 3,24), dimensione etica (la media delle risposte assume un valore di 3,32), dimensione conoscitiva (la media delle risposte è 3,08) e dimensione applicativa (con una media dei valori selezionati di 2,98). Analogamente alle scelte operate nell’indagine delle dimensioni di competenza degli insegnanti, l’individuazione dei domini relativi alle capacità degli allievi è stata compiuta con riferimento a quanto indicato nell’AI competency framework for students (UNESCO, 2024b). La figura 3 illustra la distribuzione delle risposte.

Figura 3

Livello di promozione dell’alfabetizzazione e dell’educazione all’IA rispetto a quattro dimensioni di competenza.

A conclusione del questionario, si è fatto riferimento all’ipotesi di uno studio finalizzato a indagare l’IA come strumento di supporto allo sviluppo di virtuose capacità di pensiero. In particolare, ai docenti è stato chiesto quanto ritenessero utile, in una scala da 1 a 5, un percorso di ricerca-azione volto a studiare e sviluppare prospettive formative e educative, per insegnanti e allievi, in relazione a un approccio umano all’IA, che la interpreti quale strumento di supporto, amplificazione e sviluppo delle facoltà cognitive di ordine superiore. La media delle risposte corrisponde a 3,53, a indicare un buon interesse verso tale proposta.

Conclusioni

Da quanto sinteticamente analizzato emerge come, benché l’IA sia ormai parte della vita quotidiana, personale e professionale, di ciascuno di noi, la sua introduzione a scuola sembra essere ancora a uno stadio embrionale e il suo impiego da parte degli allievi appaia poco mediato e educato. In questo senso, la scuola rischia di venire meno al compito pedagogico di intessere virtuosi legami con la società e di affrontare le emergenti istanze sociali dirigendo le trasformazioni contemporanee alla luce del proprio orizzonte teleologico (Dewey, 1951).

Da questo punto di vista, si crede che la riflessione relativa ai temi dell’IA, dal suo design alle implicazioni etiche (Floridi, 2022) debba costituire un ineludibile oggetto di interesse della pedagogia e della scuola. Il rischio, infatti, è che l’educazione, dinanzi alla rivoluzione digitale in atto, si limiti ad assumere acriticamente come proprie le ideologie, le finalità e le modalità appartenenti a strutture e categorie estranee e divergenti rispetto alla propria natura e ai propri scopi eminentemente pedagogici (Baldacci, 2019). Ciò non significa limitarsi a sottoporre a vaglio critico l’impiego delle moderne tecnologie, né, tantomeno, assumere un atteggiamento riluttante verso il progresso tecnologico, pena la formazione di individui incapaci di partecipazione attiva e consapevole alla società attuale. In risposta a scenari che preconizzano la subalternità e la sostituzione dell’uomo da parte della macchina, rischio evidenziato anche dai docenti intervistati, occorre ipotizzare e creare nuove forme di ibridazione tra esseri umani e tecnologie. In questa direzione muove, ad esempio, il paradigma dell’hybrid human-artificial intelligence (HHAI) (Järvelä et al., 2025), campo di studi emergente, il quale sostiene la possibilità e la necessità di un partenariato uomo-macchina, nella prospettiva della realizzazione di sistemi ibridi che sfruttino, a un tempo, IA e intelligenza umana e che si rivelino capaci di sovraperformare quanto entrambe sarebbero in grado di realizzare separatamente, con la finalità di amplificare le abilità umane di apprendimento, di ragionamento, di problem solving e decision making.

Dal punto di vista dell’educazione scolastica e della professionalità insegnante, ciò significa comprendere e promuovere le migliori modalità di integrazione dell’IA nei processi di apprendimento, tanto come strumento di mediazione didattica quanto come oggetto di alfabetizzazione critica (Panciroli e Rivoltella, 2023; Ranieri, Cuomo e Biagini, 2023). Tuttavia, occorre anche assumere uno sguardo più ampio che rifletta in merito alla possibilità di favorire un’efficace co-evoluzione tra Intelligenza Artificiale e intelligenza umana, ispirandosi ai principi democratici di sviluppo umano.

In questa direzione, si crede che, in una prospettiva tanto teoretica quanto pratica, sia utile comprendere in che modo le moderne tecnologie, con particolare riferimento all’IA di tipo generativo, possano essere adoperate in una logica di valorizzazione individuale e sociale. Si ritiene, dunque, necessario riflettere in merito alla creazione delle condizioni per favorire lo sviluppo di un virtuoso rapporto uomo-macchina, in una direzione per cui l’esercizio delle facoltà di pensiero di ordine superiore che caratterizzano l’umano — come riflessività, le capacità critiche e di giudizio e la creatività — sia sostenuto e catalizzato dall’impiego delle tecnologie e non da esse ostacolato.

Bibliografia

Baldacci M. (2019), La scuola al bivio. Mercato o democrazia, Milano, FrancoAngeli.

Benanti P. (2022), Human in the loop. Decisioni umane e intelligenze artificiali, Milano, Mondadori Libri.

Corbetta P. (2014), Metodologia e tecniche della ricerca sociale, Bologna, il Mulino.

Dewey J. (1951), Scuola e società, Firenze, La Nuova Italia (ed. or. 1899).

Dewey J. (2019), Come pensiamo, Milano, Raffaello Cortina (ed. or. 1933).

Floridi L. (2017), La quarta rivoluzione. Come l’infosfera sta trasformando il mondo, Milano, Raffaello Cortina.

Floridi L. (2022), Etica dell’intelligenza artificiale. Sviluppi, opportunità, sfide, Milano, Raffaello Cortina.

Harari Y.N. (2018), 21 lezioni per il XXI secolo, Milano, Bompiani.

Michelini M.C. (2013), Educare il pensiero. Per la formazione dell’insegnante riflessivo, Milano, FrancoAngeli.

Michelini M.C. (2016), Fare comunità di pensiero. Insegnamento come pratica riflessiva, Milano, FrancoAngeli.

Moravec H. (1988), Mind Children: The Future of Robot and Human Intelligence, Cambridge, Mass., Harvard University Press.

Nussbaum M.C. (2011), Non per profitto. Perché le democrazie hanno bisogno della cultura umanistica, Bologna, il Mulino.

Panciroli C. e Rivoltella P.C. (2023), Pedagogia algoritmica. Per una riflessione educativa sull’intelligenza artificiale, Brescia, Scholé.

Parlamento e Consiglio Europeo (2024), Regolamento 2024/1689, https://eur-lex.europa.eu/legal-content/IT/TXT/PDF/?uri=OJ:L_202401689 (consultato il 10 maggio 2025).

Petrucco C., Favino F. e Conte A. (2024), Teachers’ perceptions on the introduction of Generative AI in schools: A mixed-method study on the opinions of 1,223 teachers in the Veneto Region, Italy, «Education Sciences & Society», vol. 15, n. 2, pp. 17-37, https://doi.org/10.3280/ess2-2024oa18406 (consultato il 10 maggio 2025).

Ranieri M., Cuomo S. e Biagini G. (2023), Scuola e intelligenza artificiale. Percorsi di alfabetizzazione critica, Roma, Carocci.

Järvelä S., Zhao G., Nguyen A. e Chen H. (2025), Hybrid intelligence: Human — AI coevolution and learning, «British Journal of Educational Technology», vol. 56, pp. 455-468, https://doi.org/10.1111/bjet.13560 (consultato il 10 maggio 2025).

Sen A. (2001), Lo sviluppo è libertà. Perché non c’è crescita senza democrazia, Milano, Mondadori.

UNESCO (2023), Guidance for generative AI in education and research, https://www.unesco.org/en/articles/guidance-generative-ai-education-and-research (consultato il 10 maggio 2025).

UNESCO (2024a), AI competency framework for teachers, https://unesdoc.unesco.org/ark:/48223/pf0000391104 (consultato il 10 maggio 2025).

UNESCO (2024b), AI competency framework for students, https://unesdoc.unesco.org/ark:/48223/pf0000391105 (consultato il 10 maggio 2025).

-

1 Il contributo è stato concepito e sviluppato congiuntamente dalle autrici. Nello specifico, Maria-Chiara Michelini ha scritto il paragrafo Progetto Umano e IA; Sophia Crescentini ha scritto il paragrafo L’IA a scuola: un’indagine esplorativa e le Conclusioni.

-

2 Professoressa Ordinaria di Pedagogia Generale e Sociale PAED-01/A, Università degli Studi di Urbino Carlo Bo.

-

3 Dottoranda di Studi Umanistici, Università degli Studi di Urbino Carlo Bo.

-

4 Full Professor of General and Social Pedagogy (PAED-01/A), University of Urbino Carlo Bo.

-

5 PhD Candidate in Humanities, University of Urbino Carlo Bo.

Vol. 11, Issue 2, October 2025